Posibilidades ilimitadas en A-Parser

Hemos reunido todos los beneficios en una sola página; puede encontrar información detallada sobre cada función en la documentación.

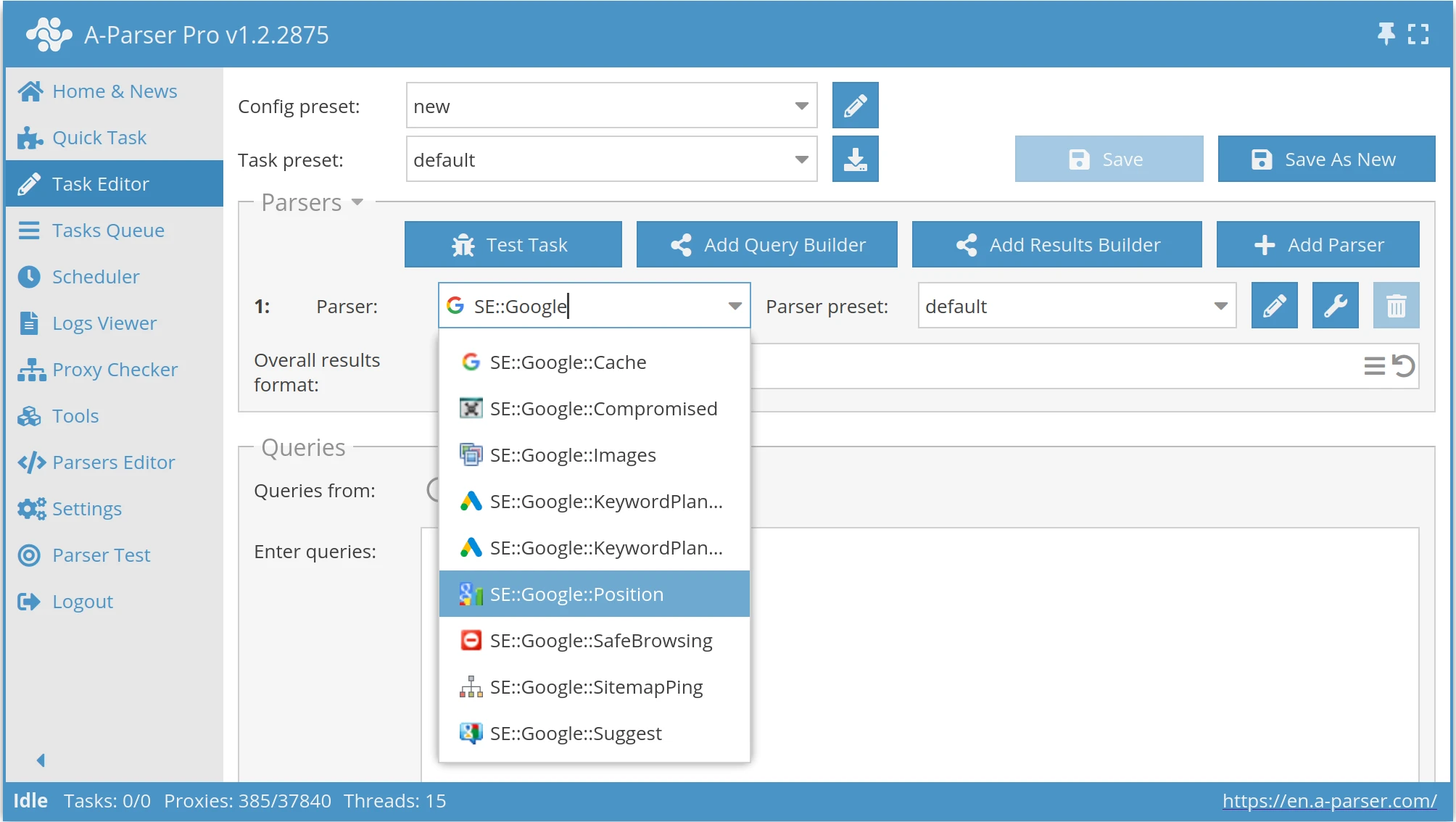

Editor de tareas

Utilice hasta 20 extractores en una sola tarea, distribuyendo los hilos de manera uniforme para reducir los bloqueos de proxies y aumentar la velocidad de extracción de datos.

Numerosas configuraciones para cada scraper pueden guardarse en preajustes separados y reutilizarse en varias tareas.

La separación de los datos de entrada le permite cambiar el formato de la consulta y escribir datos relacionados adicionales en los resultados.

Un formato de consulta separado para cada scraper dentro de una tarea, con control sobre el orden de ejecución del formateo.

Si no está seguro de los datos de entrada, A-Parser se asegura de que no se realice ningún trabajo redundante.

Expansión automática de consultas, sustitución de subconsultas de archivos e iteración a través de combinaciones alfanuméricas y listas.

El potente Template Toolkit le permite aplicar lógica adicional a los resultados y generar datos en varios formatos, incluyendo JSON, SQL y CSV.

Las capacidades avanzadas de deduplicación garantizan la unicidad de las cadenas, enlaces y dominios que recibe.

Guarde solo los datos que cumplan con sus criterios: coincidencias de subcadenas, comparaciones numéricas o expresiones regulares.

Utilice diferentes formatos para diferentes archivos y aplique condiciones y filtros adicionales, todo dentro de una sola tarea para conservar los recursos de análisis.

Un registro detallado para cada hilo y cada consulta permite una depuración rápida y conveniente de las tareas.

Extienda la lógica de A-Parser ejecutando automáticamente diferentes tareas en secuencia, pasando los resultados de una tarea como consultas para la siguiente.

¿Construyendo bases de datos a partir de múltiples tareas? El guardado de las bases de datos de deduplicación garantiza que siempre obtendrá solo resultados nuevos.

Al ejecutar cada tarea con un número específico de hilos, puede asegurarse de que A-Parser no exceda su plan de proxies o los recursos de su servidor.

Utilice el depurador para verificar rápidamente el funcionamiento de una tarea durante su creación, con una ejecución rápida y una visualización clara del registro.

Cola de tareas y programador

La cola de tareas le libera de esperar a que termine una tarea. Añada un número ilimitado de tareas independientes.

Controle el número de tareas que se ejecutan simultáneamente, reduciendo significativamente el tiempo total para obtener resultados.

Inicie, pause, edite o elimine tareas. Reanude las tareas desde donde las dejó; A-Parser continuará recopilando información.

Con una gran cola de tareas, es crucial controlar qué tareas comienzan antes que otras.

Establezca un límite global de hilos para todas las tareas, y A-Parser distribuirá automáticamente los hilos entre las tareas activas.

Acceda a un historial completo de tareas completadas, vea estadísticas y vuelva a añadir tareas para otra ejecución.

Ejecute tareas recurrentes utilizando el programador de tareas con configuraciones flexibles para los intervalos de repetición.

Verificadores de proxies y gestión de proxies

A-Parser funciona con todos los protocolos proxy, y el verificador de proxies puede probar todos los tipos simultáneamente.

Añada verificadores de proxies separados para diferentes fuentes de proxies, cada uno con sus propias configuraciones de verificación.

Gestione el número de hilos de verificación y descarga por separado para cada verificador de proxies.

Especifique las credenciales de acceso del proxy en la configuración del verificador de proxies o en listas de proxies con datos de autorización separados.

A-Parser verifica el soporte del método POST, el anonimato, el tiempo de respuesta y otros parámetros de los proxies.

Si confía en que sus proxies funcionan, puede desactivar la verificación para ahorrar recursos.

Para cada tarea, puede seleccionar fuentes de proxies específicas, lo que permite una asignación flexible de recursos.

Para una flexibilidad aún mayor, utilice diferentes proxies dentro de una sola tarea, como proxies separados para los scrapers de Google y Yandex.

Si un servicio bloquea un proxy, A-Parser dejará de usarlo durante un tiempo especificado, reduciendo las solicitudes fallidas.

Puede limitar el número máximo de hilos por proxy para evitar el uso excesivo de sus recursos.

Por defecto, A-Parser utiliza un proxy único para cada intento de descarga de datos, pero este comportamiento puede cambiarse.

Esta función le permite excluir ciertos proxies del uso general y asignarlos solo a tareas específicas.

Configuraciones flexibles

Guarde grupos de configuraciones en diferentes preajustes y reutilícelos en varias tareas.

Por ejemplo, el scraper de Google permite especificar el número de páginas, resultados por página, configuraciones de idioma, geolocalización y mucho más.

Exporte sus configuraciones y scrapers para compartirlos con otros, o importe tareas preestablecidas de nuestro catálogo.

Multihilo y rendimiento

A-Parser está construido sobre una arquitectura completamente asíncrona, capaz de ejecutar hasta 10.000 hilos asíncronos concurrentes.

A-Parser emplea muchas optimizaciones para un mejor rendimiento, y constantemente perfilamos y mejoramos nuestro código.

No hay límites en el número de consultas, el tamaño de los archivos de consulta o el número de resultados.

La mayoría de las tareas se ejecutan sin problemas en cualquier ordenador de oficina o doméstico estándar, así como en cualquier VDS de nivel básico.

Actualmente, A-Parser puede utilizar eficientemente hasta 4 núcleos de procesador. Pronto estará disponible una licencia con soporte ilimitado de núcleos.

Reconocimiento de captchas

El software de reconocimiento CAPTCHA más popular soporta muchos tipos de CAPTCHAs, incluyendo reCAPTCHA v2.

Ofrecemos integración con la gran mayoría de servicios, incluyendo Anti-Captcha, RuCaptcha, CapMonster.cloud, 2captcha y otros.

El soporte de reconocimiento de CAPTCHA está integrado en todos los scrapers populares. También puede usarlo desde sus propios scrapers personalizados de JavaScript.

Desarrollo de preajustes basados en expresiones regulares

Aplique expresiones regulares a los datos obtenidos del scraper Net::HTTP o del spider HTML::LinkExtractor.

Recopile puntos de datos individuales en variables o bloques repetitivos (listas, tablas) en arrays. Muestre los datos en un formato conveniente utilizando el motor de plantillas.

Puede aplicar procesamiento adicional a los datos fuente de todos los scrapers integrados (por ejemplo, resultados de búsqueda de Google).

Utilice expresiones regulares para encontrar enlaces a la siguiente página de paginación, y A-Parser navegará automáticamente por todas las páginas.

Utilice expresiones regulares para validar contenido, verificar bloqueos de proxies o detectar captchas. A-Parser reintentará automáticamente con otro proxy en caso de fallo.

Con el constructor de resultados, puede realizar operaciones de búsqueda y reemplazo utilizando expresiones regulares en los resultados de scraping.

Desarrollo de Scrapers en JavaScript

Código lineal y síncrono utilizando async/await, que A-Parser ejecutará en un entorno multihilo.

A-Parser le permite concentrarse en escribir código de extracción y transformación de datos, manejando automáticamente toda la gestión de proxies y los reintentos.

Escriba en JavaScript moderno (ES2020+) o utilice TypeScript para una tipificación fuerte y resaltado de sintaxis.

El vasto catálogo de módulos NPMJS le permite extender las capacidades de extracción y procesamiento de datos de A-Parser de forma ilimitada.

A-Parser añade soporte para proxies a la popular biblioteca Puppeteer, permitiendo el uso automático de diferentes proxies para diferentes pestañas.

Puede enviar solicitudes a cualquier scraper integrado o a otros scrapers de JavaScript, lo que permite la creación de lógica arbitrariamente compleja.

Automatización y API

Envíe solicitudes HTTP desde sus propios programas y scripts, o utilice nuestras bibliotecas prefabricadas para Node.js, Python, PHP y Perl.

Añada tareas por nombre de preajuste o proporcionando una estructura JSON completa con configuraciones detalladas.

Obtenga control total sobre la cola de tareas, rastree los estados de las tareas y descargue los resultados.

Envíe una solicitud HTTP y reciba los resultados inmediatamente al finalizar la recopilación de datos.

Nuestra solución para proyectos de alta carga. Conecte un número ilimitado de instancias de A-Parser para procesar solicitudes API en una cola de Redis con mínima latencia.

Para una automatización completa, está disponible una actualización remota de A-Parser a través de una llamada a la API.

Mejoras continuas y soporte

La constante evolución de A-Parser proporciona a nuestros usuarios nuevas capacidades año tras año.

Probamos todos los scrapers integrados diariamente y automáticamente, lo que nos permite lanzar actualizaciones rápidamente en respuesta a cualquier cambio de diseño o resultado.

El soporte técnico gratuito está disponible para todos nuestros usuarios y es considerado por ellos como el mejor entre productos similares.

Publicamos regularmente materiales educativos, ejemplos de preajustes y extractores, así como vídeos tutoriales en nuestro canal de YouTube.

La mayoría de las nuevas funciones y scrapers se desarrollan basándose en las solicitudes de nuestros usuarios.

Podemos ahorrarle tiempo ofreciendo el desarrollo personalizado de scrapers en nuestra plataforma, así como la integración con su lógica de negocio y bases de datos.

Elija la licencia adecuada

Licencia de por vida, las actualizaciones se compran por separado

A-Parser Lite

Extractores básicos de Google y Yandex

- Incluye extractores de Google y Yandex

- 3 meses de actualizaciones

- Proxies adicionales: 20 hilos durante 2 semanas

- Soporte

A-Parser Pro

Acceso a todos los extractores

- Suite completa de más de 110 extractores

- Cree sus propios extractores JavaScript

- 6 meses de actualizaciones

- Proxies adicionales: 50 hilos durante un mes

- Incluye todas las características del plan Lite

A-Parser Enterprise

Acceso a todos los extractores y API

- Control de API

- Procesamiento de tareas multinúcleo

- Integración con Redis

- Incluye todas las características del plan Pro

Actualizaciones: $49 por 3 meses, $149 por un año, o $399 de por vida

Soluciones de pago

Desarrollo de extractores personalizados

Creemos que cualquier dato puede extraerse.