Allgemeine Informationen

A-Parser - der Parser für Profis

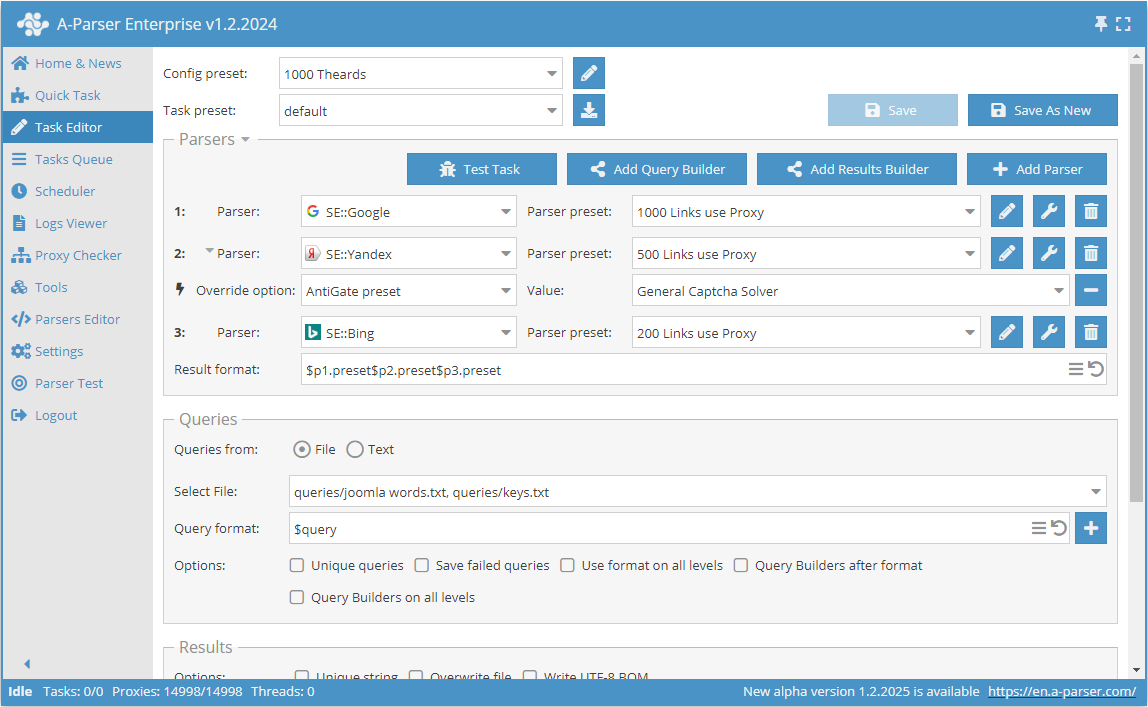

A-Parser - ein Multithreading-Parser für Suchmaschinen, Website-Bewertungsdienste, Keywords, Content (Text, Links, beliebige Daten) und verschiedene andere Dienste (YouTube, Bilder, Übersetzer...), A-Parser enthält mehr als 90 integrierte Scraper.

Die Hauptmerkmale von A-Parser sind die Unterstützung der Plattformen Windows/Linux, ein Webinterface mit Fernzugriffsmöglichkeit, die Option zur Erstellung eigener Scraper ohne Programmierung sowie die Möglichkeit, Scraper mit komplexer Logik in den Sprachen JavaScript / TypeScript mit Unterstützung von NodeJS-Modulen zu entwickeln.

Leistungsfähigkeit, Arbeit mit Proxys, Umgehung des CloudFlare-Schutzes, eine schnelle HTTP-Engine, Unterstützung der Chrome-Steuerung über puppeteer, Steuerung des Parsers per API und vieles mehr machen A-Parser zu einer einzigartigen Lösung. In dieser Dokumentation werden wir versuchen, alle Vorteile von A-Parser und dessen Einsatzmöglichkeiten aufzuzeigen.

Einsatzbereiche

A-Parser ist in der Lage, eine Vielzahl von Aufgaben zu lösen. Zur besseren Übersicht haben wir diese nach Anwendungsbereichen kategorisiert. Folgen Sie den untenstehenden Links für Details:

KI-Integrationen

SEO-Spezialisten und Agenturen

Unternehmen und Freiberufler

Für Entwickler

Vermarkter und Analysten

E-Commerce und Marktplätze

Affiliate-Vermarkter

Funktionen und Vorteile

In diesem Abschnitt haben wir die Hauptvorteile von A-Parser kurz aufgelistet. Weitere Informationen finden Sie unter dem folgenden Link:

Übersicht aller Funktionen

⏩ Webinar zu A-Parser: Übersicht und Antworten auf Fragen

Multithreading und Performance

- A-Parser basiert auf den neuesten Versionen von NodeJS und der JavaScript-Engine V8

- AsyncHTTPX - eigene Implementierung der HTTP-Engine mit Unterstützung für HTTP/1.1 und HTTP/2, HTTPS/TLS, Unterstützung für HTTP/SOCKS4/SOCKS5-Proxys mit optionaler Authentifizierung

- Der Parser kann HTTP-Anfragen in fast unbegrenzter Anzahl gleichzeitiger Threads ausführen, abhängig von der Computerkonfiguration und der jeweiligen Aufgabe

- Jede Aufgabe (Satz von Abfragen) wird in der angegebenen Thread-Anzahl verarbeitet

- Bei Verwendung mehrerer Scraper in einer Aufgabe wird jede Anfrage an verschiedene Scraper gleichzeitig in unterschiedlichen Threads ausgeführt

- Der Parser kann mehrere Aufgaben parallel starten

- Prüfung und Laden von Proxys aus Quellen erfolgt ebenfalls im Multithreading-Modus

Erstellung eigener Scraper

- Möglichkeit zur Erstellung von Scrapern ohne Programmierung

- Verwendung regulärer Ausdrücke

- Unterstützung für mehrseitige Datenerfassung

- Überprüfung von Inhalten und Vorhandensein der nächsten Seite

- Ersetzung des User-Agents und die Möglichkeit, diesen bei jeder Anfrage zufällig zu ändern

- Verschachtelte Datenerfassung - Möglichkeit, erhaltene Ergebnisse in Abfragen einzusetzen

- Vollständige Arbeit mit JSON: Analyse und Erstellung

- Möglichkeit, eigene JS-Funktionen hinzuzufügen und zu verwenden, um die erhaltenen Ergebnisse direkt im Parser zu verarbeiten

Erstellung von Scrapern in JavaScript

- Umfangreiche integrierte API auf Basis von async/await

- Unterstützung für TypeScript

- Möglichkeit zum Einbinden beliebiger NodeJS-Module

- Steuerung von Chrome/Chromium über puppeteer mit Unterstützung für separate Proxys für jeden Tab

Mächtige Werkzeuge zur Gestaltung von Abfragen und Ergebnissen

- Abfrage-Builder und Ergebnis-Builder - ermöglichen die Datenmodifikation (Suchen und Ersetzen, Domain aus Link extrahieren, Transformationen per RegEx, XPath...)

- Platzhalter für Abfragen - aus Dateien; Iteration über Wörter, Zeichen und Zahlen, auch mit festgelegter Schrittweite

- Filterung der Ergebnisse - nach Vorkommen von Teilstrings, Gleichheit, größer/kleiner

- Eindeutigkeit der Ergebnisse - nach Zeile, nach Domain, nach Hauptdomain (A-Parser kennt alle Top-Level-Domains, inkl. solcher wie co.uk, msk.ru)

- Mächtige Ergebnis-Template-Engine basierend auf Template Toolkit - ermöglicht die Ausgabe der Ergebnisse in jeder gewünschten Form (Text, CSV, HTML, XML, benutzerdefiniertes Format)

- Im Parser wird ein System von Presets verwendet - für jeden Scraper können zahlreiche vordefinierte Einstellungen für verschiedene Situationen erstellt werden

- Alles ist konfigurierbar - keine Grenzen oder Einschränkungen

- Export und Import von Einstellungen ermöglicht den einfachen Erfahrungsaustausch mit anderen Nutzern