HTML::ArticleExtractor - Scraper d'articles

Présentation du scraper

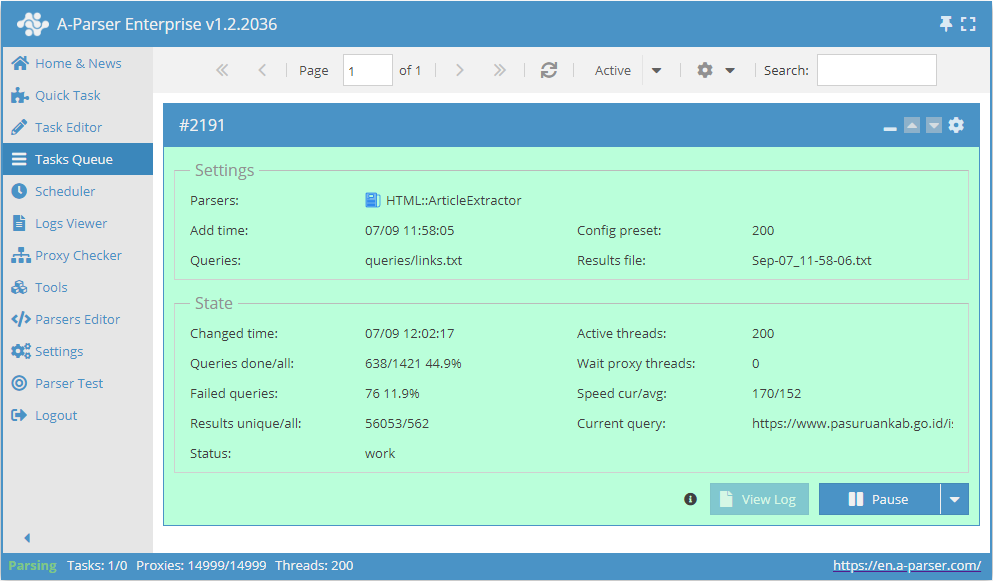

HTML::ArticleExtractor collecte des articles à partir de pages web.

HTML::ArticleExtractor collecte des articles à partir de pages web.Fonctionne à l'aide du module @mozilla/readability qui est intégré à A-Parser et collecte des données principales telles que : le titre, le contenu avec et sans mise en page HTML, la longueur de l'article.

Utilise à la base le scraper  Net::HTTP, ce qui permet de maintenir ses fonctionnalités. Supporte la collecte multipage (pagination). Possède des outils intégrés pour contourner la protection CloudFlare ainsi que la possibilité de choisir Chrome comme moteur pour scraper les emails des pages dont les données sont chargées par des scripts.

Net::HTTP, ce qui permet de maintenir ses fonctionnalités. Supporte la collecte multipage (pagination). Possède des outils intégrés pour contourner la protection CloudFlare ainsi que la possibilité de choisir Chrome comme moteur pour scraper les emails des pages dont les données sont chargées par des scripts.

Capable d'atteindre une vitesse de 200 requêtes par minute – soit 12 000 liens par heure.

Données collectées

- Titre de l'article -

$title - Chaîne HTML du contenu traité de l'article -

$content - Contenu textuel de l'article (tout le HTML est supprimé) -

$textContent - Longueur de l'article en caractères -

$length - Description de l'article ou court extrait du contenu -

$excerpt - Métadonnées de l'auteur -

$byline - Nom du site -

$siteName

Fonctionnalités

- Collecte de données multipages (navigation par pages)

- Prend en charge les compressions gzip/deflate/brotli

- Détection et conversion de l'encodage des sites en UTF-8

- Contournement de la protection CloudFlare

- Choix du moteur (HTTP ou Chrome)

- Possibilité de définir la longueur de l'article

- Collecte d'articles avec et sans balises HTML

Cas d'utilisation

- Collecte d'articles prêts à l'emploi à partir de n'importe quel site

Requêtes

En tant que requêtes, vous devez spécifier les liens vers les pages à partir desquelles vous souhaitez scraper les articles, par exemple :

https://a-parser.com/docs/

https://lenta.ru/articles/2021/09/11/buran/

https://www.thetimes.co.uk/article/the-russian-banker-the-royal-fixers-and-a-500-000-riddle-vvgc55b2s

Exemples de formats de résultats

A-Parser prend en charge un formatage flexible des résultats grâce au moteur de gabarit intégré Template Toolkit, ce qui lui permet de sortir les résultats sous n'importe quelle forme, ainsi que de manière structurée, par exemple en CSV ou JSON

Paramètres possibles

Paramètres communs pour tous les scrapers

Prend en charge tous les paramètres du scraper  Net::HTTP.

Net::HTTP.